Cuando un usuario hace una consulta a ChatGPT, genera una imagen con NanoBanana o entrena un modelo de lenguaje de IA propio, pocas veces piensa en lo que ocurre al otro lado de la pantalla, miles de servidores trabajando a plena capacidad, consumiendo energía de forma voraz, y disipando calor. Mucho calor.

Ahora, por primera vez, un equipo de investigadores de universidades como Cambridge de EE. UU., Nanyang Technological University de Singapur y City University of Hong Kong, entre otras, ha puesto números a ese fenómeno.

Incluso, acuñaron un término que promete usarse en el vocabulario del debate ambiental, que es “el efecto de isla de calor de datos”.

El estudio, publicado en el pasado mes de marzo, analiza registros de temperatura superficial terrestre (LST, por sus siglas en inglés) capturados por satélites de la Nasa entre 2004 y 2024, cruzándolos con la ubicación de más de 11.000 centros de datos en todo el mundo.

El resultado más llamativo de la investigación es que donde se instala un hiperescalador de inteligencia artificial, la temperatura del suelo sube.

Puede leer: Así funciona la guerra millonaria por la inteligencia artificial: Google, Meta y Nvidia lideran

¿Qué es el efecto de isla de calor de datos y cómo funciona?

El concepto no es caprichoso, según Andrea Marinoni, profesor asociado del grupo de Observación de la Tierra de la Universidad de Cambridge y autor del estudio, sino que se construye sobre la analogía con el ya conocido efecto de isla de calor urbano (UHI, urban heat island)

Así las cosas, ese es el fenómeno por el cual las ciudades tienen varios grados más cálidos que el campo que las rodea debido a la concentración de asfalto, edificios, industria y falta de vegetación. La diferencia es que los centros de datos crean su propia versión de ese fenómeno incluso fuera de los grandes núcleos urbanos.

Tras depurar más de 6.700 puntos de datos válidos, eliminando ubicaciones dentro de zonas urbanas densas para aislar el efecto exclusivo de los centros de datos, los investigadores llegaron a una cifra que sorprendió incluso a los propios autores del estudio.

“La temperatura de la superficie terrestre aumenta 2,07 °C (grados Celsius) en promedio tras el inicio de operaciones de un centro de datos de IA, induciendo zonas de microclima local, a las que llamamos el efecto de isla de calor de datos”, detalló Marinoni, de la Universidad de Cambridge.

Ese promedio de 2,07 °C oscila entre 1,5 °C y 2,4 °C. Pero, según los investigadores, el dato adquiere una dimensión distinta cuando se considera que el pico máximo registrado en alguno de los casos analizados llegó a 9,1 °C, y que el impacto no se detiene en la puerta del edificio.

El calor se extiende hasta un radio de 10 kilómetros, manteniendo una intensidad equivalente al 30% del valor central incluso a 7 kilómetros de distancia del núcleo del hiperescalador. A 4,5 kilómetros del centro, el aumento promedio sigue siendo de 1 °C.

Puede conocer más: Se confirma lo que todos sospechaban: la Inteligencia Artificial es aduladora y mala consejera, según estudio

¿Cuánta energía consume un centro de datos de IA?

Para entender la magnitud del problema, vale la pena poner en perspectiva el apetito energético de estas instalaciones. Un solo centro de datos de IA de hiperescala requiere entre 50 y más de 100 megavatios (MW) de potencia continua, equivalente a la carga eléctrica de una ciudad de 80.000 a 100.000 habitantes, según Statista.

A su vez, la Agencia Internacional de Energía (IEA) reveló que, en 2024, el sector en su conjunto consumió aproximadamente 415 teravatios-hora (TWh), alrededor del 1,5% de toda la electricidad mundial.

En esa misma línea, la Agencia Internacional de la Energía proyecta que ese volumen casi se duplicará para 2030, llegando a 945 TWh, más que el consumo eléctrico actual de Japón.

En Estados Unidos, el fenómeno es aún más evidente, con 183 TWh en 2024 (4,4% del total nacional) y proyecciones de hasta 12% en el cierre de la década. “La limitación del crecimiento de la IA ya no serán los chips, sino la electricidad disponible”, advierte la Agencia Internacional de la Energía.

Incluso, algunos proyectos llevan esa lógica al extremo. El campus Hyperion de Meta, en Estados Unidos, está diseñado para alcanzar hasta 5 gigavatios (GW), una demanda comparable a tres veces el consumo eléctrico de Nueva Orleans.

Un rack (sistema) tradicional de servidores consume entre 5 y 10 kilovatios. Un rack optimizado para IA, equipado con las GPU Nvidia H100 o Blackwell más recientes, supera los 60 kW, entre 6 y 12 veces más, según cifras de la IEA, el Laboratorio Nacional Lawrence Berkeley y el informe de infraestructura de Bloom Energy.

Y entrenar un modelo como GPT-4 requirió más de 50 gigavatios-hora, equivalentes al consumo anual de más de 40.000 hogares estadounidenses. Como ha advertido la propia IEA, el límite del crecimiento de la IA ya no serán los chips, sino la electricidad disponible.

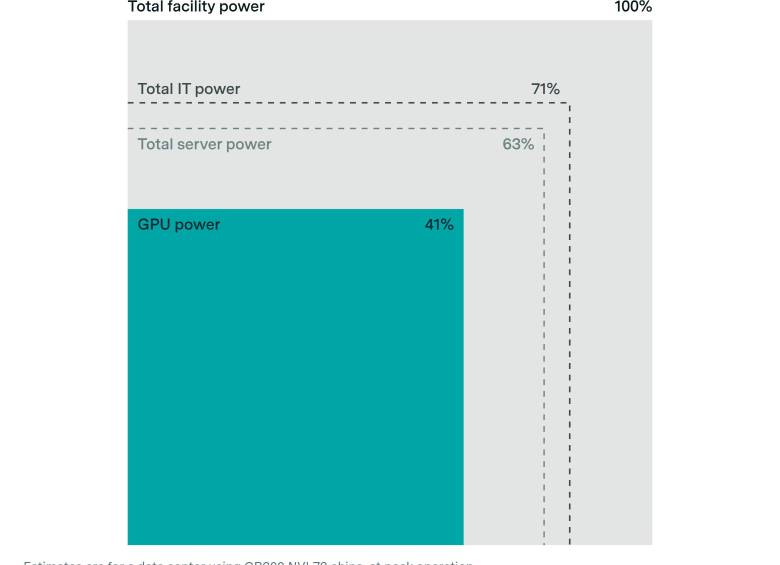

Además, de acuerdo con Epoch IA, dentro de un centro de datos, el uso de energía se distribuye de manera desigual. Cerca del 60% se destina a servidores y GPUs, solo estas últimas representan alrededor del 40%.

La refrigeración consume entre 7% y 30%, y el resto se reparte entre pérdidas eléctricas, sistemas de respaldo e infraestructura de red. En conjunto, hasta el 65% de la energía puede no convertirse directamente en cómputo útil, lo que explica por qué el calor residual es un subproducto inevitable.

México, España y Brasil: tres territorios en el ojo del huracán térmico

El estudio va más allá de los promedios globales e identifica tres casos geográficos donde el aumento de temperatura coincide documentalmente con la llegada de grandes operadores de datos, creando lo que los autores describen como anomalías térmicas inexplicables por otros factores antropogénicos locales.

El Bajío mexicano: un hub logístico que paga el precio del calor

La región del Bajío, en el centro de México, lleva dos décadas consolidándose como un destino privilegiado para los centros de datos orientados al mercado norteamericano. Su clima estable, baja actividad sísmica y ubicación estratégica la convirtieron en un imán para los principales operadores globales.

Pero ese dinamismo tiene un costo térmico: el estudio registra una tendencia de aumento de la temperatura superficial en el orden de 2 °C durante las últimas dos décadas, una anomalía que no se observa en las áreas contiguas.

Los investigadores señalan que este patrón “no fue identificado en zonas próximas”, lo que refuerza la conexión directa con la actividad de los hiperescaladores.

Puede enterarse más: De chatbot a asistente: Claude ya puede usar su computador para ejecutar tareas paso a paso, ¿cómo funciona?

Aragón, España: el hub europeo de IA y su huella térmica silenciosa

En Europa, la región española de Aragón ha emergido en los últimos años como un nodo crítico para la computación en la nube y la inteligencia artificial de alto rendimiento. Grandes operadores globales han instalado allí infraestructuras de hiperescala.

El resultado es un incremento térmico de aproximadamente 2 °C que, según el análisis, “destaca sobre las tendencias de las provincias vecinas de España, así como respecto al aumento de temperatura global monitoreado en Europa”.

Es decir, Aragón se calienta más y más rápido que sus vecinos, y la expansión de los centros de datos aparece como la variable diferencial.

Ceará y Piauí, Brasil: la proyección más alarmante del estudio

El caso más preocupante que documenta la investigación se ubica en el noreste de Brasil, y en particular en los alrededores de Teresina, capital del estado de Piauí. Esta zona se ha convertido en un hub regional para servicios de IA, y las cifras son las más elevadas de los tres casos de referencia.

Las temperaturas han subido 2,8 °C en el área de influencia de los centros de datos, y las proyecciones apuntan a que ese incremento podría alcanzar 3,5 °C en los próximos cinco años, una trayectoria que los autores califican de “bastante inusual respecto a otras áreas del norte de Brasil y el Brasil ecuatorial”.

La dimensión humana de estos datos es la que da al estudio su mayor peso político y social. Más de 343 millones de personas viven actualmente dentro del radio de influencia de estas islas de calor de datos, entendido como 10 kilómetros en torno a los hiperescaladores analizados.

Las consecuencias, según la investigación, se concentran en el calor que impacta directamente en la salud pública, la calidad del aire, el consumo energético doméstico y la gestión del agua.

“Esto hace que el efecto de isla de calor de datos sea un fenómeno muy difícil de considerar negligible, ya que puede conducir, al igual que el efecto de isla de calor urbano, a un impacto dramático sobre el bienestar, la salud y los sistemas energéticos”, señaló Marinoni.

Además: La IA ya puede dirigir una empresa: CEO de Nvidia dice que llegaron a un nivel que supera al ser humano

La carrera por la eficiencia de la IA: ¿qué soluciones existen?

Ante la magnitud del problema, el estudio no se limita a documentar el daño, los autores también propone un mapa de soluciones que combina innovación en software, hardware e incluso una reconfiguración teórica de lo que entendemos por inteligencia artificial. Los investigadores agrupan las estrategias en dos grandes categorías.

1. Eficiencia desde el código: menos datos, menos calor

En el frente del software, la clave está en cómo se organiza y procesa la información. Las redes isogeométricas, es decir, arquitecturas matemáticas que modelan los datos como realizaciones de fuerzas de propagación y advección, permiten identificar la relevancia real de cada componente del dataset, eliminando conexiones redundantes y concentrando el esfuerzo computacional en lo verdaderamente significativo.

De manera complementaria, técnicas de poda (pruning) y compresión de modelos de aprendizaje profundo reducen la carga de cómputo sin sacrificar precisión. El uso de marcos de trabajo conscientes del carbono para modelos generativos de lenguaje (LLM) busca equilibrar la calidad de los resultados con el ahorro energético, mediante directivas estratégicas en la generación de tokens.

2. Innovación en hardware: de los chips adiabáticos al enfriamiento pasivo

En el terreno del hardware, uno de los desarrollos más prometedores son los circuitos adiabáticos, es decir, chips de baja potencia que utilizan lógica reversible y recuperación de energía para reducir drásticamente las pérdidas durante la computación, lo que se traduce directamente en menos calor disipado al entorno.

Si bien su escala para los modelos de IA actuales presenta limitaciones técnicas, la dirección es clara para ponerlos en marcha.

Según los investigadores, la gestión dinámica de la potencia, mediante sistemas de soporte de baterías inteligentes combinados con optimización de carga y temperatura, puede mejorar la eficiencia operativa de los centros de datos de forma sustancial, reduciendo los tiempos de inactividad y protegiendo la infraestructura de fluctuaciones en la red eléctrica.

Pero quizá la solución más llamativa que describe el estudio es el enfriamiento radiativo pasivo. Se trata de recubrimientos de compuesto de polímero y nanopartículas aplicados sobre las superficies externas de los edificios.

Estos materiales tienen una doble función, por un lado, reflejan la luz solar (reduciendo la ganancia de calor exterior) y emiten radiación infrarroja hacia el espacio profundo (disipando el calor sin consumir electricidad). Los resultados en aplicaciones reales, desde estructuras residenciales hasta instalaciones de almacenamiento agrícola, muestran reducciones en la carga de enfriamiento de entre el 10% y el 40%, dependiendo de factores como la orientación, el albedo superficial y las condiciones climáticas locales.

Además lea: La IA duplicará la demanda de electricidad para los centros de datos

Regístrate al newsletter

Regístrate al newsletter